Série analysant comment la critique de l’ESG créé l’opportunité de rappeler la valeur de ces réflexions au sein des entreprises.

En période de turbulences, les façades corporatives se fissurent, révélant la vérité derrière les communiqués de presse soigneusement rédigés. La récente décision de Meta de réduire ses efforts de modération de contenu sur Facebook illustre parfaitement comment les périodes difficiles exposent la réalité derrière les engagements de responsabilité sociale des entreprises. Explorez au travers de ce cas les enseignements à tirer et comment opérer differemment.

L’Illusion de la Modération de Contenu

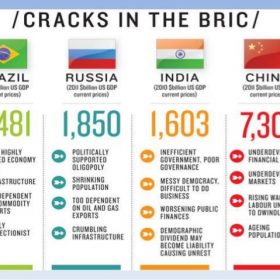

L’historique de la modération des réseaux sociaux révèle un schéma troublant d’échecs systémiques et de promesses vides. Prenons le parcours de Facebook : en 2017, ses algorithmes ont été accusés d’avoir intensifié la haine contre les Rohingyas, contribuant à des violences réelles et à la persécution. L’entreprise s’est excusée et a promis d’améliorer ses mesures de modération. En 2023, la même plateforme est accusée de censure systématique des contenus liés à la Palestine, étouffant effectivement les discussions cruciales sur les droits humains concernant la situation à Gaza.

Que s’est-il passé entre ces deux crises ? Malgré de grandes promesses, les améliorations réelles de la modération sont restées négligeables. La stratégie de la plateforme a continué de reposer largement sur l’intelligence artificielle et des contractuels sous-payés, les modérateurs humains ne disposant que de quelques secondes pour prendre des décisions complexes. Les algorithmes, conçus principalement pour maximiser l’engagement, ont systématiquement amplifié les contenus clivants tout en peinant à identifier les violations nuancées des standards communautaires.

Comment fonctionne le Greenwashing et sa Vision Court-termiste

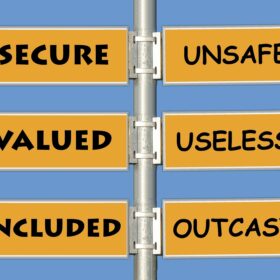

Cette révélation expose le lien profond entre le greenwashing (écoblanchiment) et la gestion à court terme. Le modèle économique des réseaux sociaux repose fondamentalement sur la rétention de l’audience le plus longtemps possible. Les contenus provocateurs créent le buzz, les points de vue radicaux polarisent les discussions, et l’engagement accru maintient les utilisateurs en ligne plus longtemps – tout cela générant un succès commercial immédiat.

Cependant, cette focalisation sur le court terme révèle une dangereuse myopie. En privilégiant l’engagement sur la responsabilité, ces plateformes démontrent une incompréhension profonde de leur rôle sociétal. Plus elles permettent aux contenus inflammatoires de prospérer, plus elles érodent leur crédibilité et leur légitimité sociale. Cela crée une spirale descendante dangereuse : les utilisateurs modérés explorent des alternatives, les annonceurs deviennent méfiants à l’idée d’associer leurs marques à des plateformes controversées, et les organismes de réglementation envisagent des restrictions sur les services qui menacent le discours démocratique.

Le Besoin d’une Véritable Responsabilisation

Pour avancer, nous avons besoin de cadres réglementaires robustes exigeant transparence et résultats vérifiés, pas seulement des promesses. L’absence d’efforts sérieux de modération expose les plateformes à une complicité dans les violations des droits humains, pouvant déclencher une responsabilité pénale dans de nombreuses juridictions.

Les plateformes de médias sociaux, comme toute autre industrie, doivent être tenues responsables de leur impact réel, pas de leurs intentions déclarées. Cela implique de mettre en place :

- Des mécanismes de surveillance indépendants

- Des résultats clairs et mesurables

- Des audits publics réguliers

- Des conséquences exécutoires en cas de non-conformité

- Des cadres et directives pour le développement éthique de l’IA

L’intégration de l’éthique dans les processus de développement de l’IA est particulièrement cruciale. Avec de nombreux cadres établis disponibles pour le déploiement éthique de l’IA, les plateformes ne peuvent plus prétendre ignorer comment mettre en œuvre une modération de contenu responsable.

Conclusion

La clarté émerge de ces temps troublés. Alors que le greenwashing des entreprises devient plus évident à travers des événements comme l’abandon de la modération sur les réseaux sociaux, nous avons l’opportunité de reconstruire avec une véritable responsabilité au cœur des pratiques dont les risques et enjeux s’appliquent évidemment bien au-delà du cercle des médias sociaux mais concernent toutes les entreprises de tous les secteurs.

Pour les organisations prêtes à dépasser les engagements superficiels, une voie existe. Ksapa apporte une expérience approfondie acquise auprès des principales entreprises technologiques par exemple pour mettre en œuvre un changement significatif. Nos méthodologies robustes et notre équipe d’experts aident les entreprises à structurer leur approche de la responsabilité en matière de droits humains et d’engagement des parties prenantes. Créer de la confiance avec le client / consommateur en le mettant au coeur des préoccupations éthiques. Nous guidons les organisations pour :

- Identifier et clarifier les risques opérationnels

- Développer des approches structurées face aux défis des droits humains

- Mettre en œuvre des processus de responsabilisation efficaces

- Construire des relations durables avec les parties prenantes

Les entreprises désireuses d’agir différemment et de construire de meilleures pratiques commerciales peuvent nous contacter pour obtenir des conseils. Ensemble, nous pouvons créer des entreprises technologiques qui servent véritablement la société tout en maintenant une croissance durable.

Contactez Ksapa aujourd’hui pour découvrir comment nous pouvons aider votre organisation à construire un avenir plus responsable et durable.

Président et Cofondateur. Auteur de différents ouvrages sur les questions de RSE et développement durable. Expert international reconnu, Farid Baddache travaille à l’intégration des questions de droits de l’Homme et de climat comme leviers de résilience et de compétitivité des entreprises. Restez connectés avec Farid Baddache sur Twitter @Fbaddache.